De Bernoulli a Merton: o esqueleto de um modelo de risco de crédito

Por que o modelo ingênuo de default independente falha quando a carteira encontra risco sistêmico, e como essa falha leva dos modelos atuariais aos estruturais em risco de crédito.

Considere uma carteira com 10 mil tomadores, probabilidade de default (PD) de 1% para cada um, exposição unitária e perda dado default (LGD) de 40%. A carteira parece grande o bastante para preocupar qualquer gestor de risco, mas a hipótese de defaults independentes empurra o VaR 99% para cada vez mais perto da perda esperada conforme o número de tomadores cresce. No limite, quase todo o capital econômico necessário desaparece por diversificação, justamente porque o modelo tratou a quebra de cada nome como um evento isolado dos demais.

A inconsistência não está na álgebra, que faz exatamente o que foi pedido, e sim na premissa econômica. Recessões, choques setoriais e apertos de liquidez não selecionam tomadores por sorteio independente. Eles comprimem receitas, margens, refinanciamento e valor de colateral de muitos devedores ao mesmo tempo, razão pela qual uma carteira de crédito precisa de algum mecanismo explícito para transformar estado da economia em dependência entre defaults.

A indústria de risco de crédito se reorganizou em torno desse problema no fim dos anos 1990. Em abril de 1997, o JP Morgan publicou o CreditMetrics Technical Document, um manual de 198 páginas que formalizava, em linguagem aberta, como estimar a distribuição de perdas de uma carteira inteira a partir de probabilidades de transição de rating e correlação de ativos (GUPTON; FINGER; BHATIA, 1997). Seis meses depois, o Credit Suisse Financial Products respondeu com o CreditRisk+: A Credit Risk Management Framework, uma metodologia atuarial que ignora balanços e trata o default como evento aleatório com intensidade estocástica (CREDIT SUISSE FINANCIAL PRODUCTS, 1997). Embora partissem de tradições diferentes, os dois documentos atacavam a mesma deficiência dos modelos independentes, pois ambos buscavam representar a possibilidade de vários tomadores quebrarem na mesma situação de crise enfrentada.

Quase três décadas depois, a linhagem que começou naqueles dois documentos ainda define boa parte do que se entende por capital econômico relativo à crédito em bancos regulados. Entre o modelo independente e os modelos estruturais multifatoriais de hoje, a evolução da modelagem pode ser lida como uma sequência de correções sobre hipóteses que se mostraram convenientes demais quando confrontadas com carteiras reais, sobretudo a independência, a forma da cauda e a concentração.

Em Modelling Economic Capital, David Jamieson Bolder (2022) reconstrói essa engenharia a partir do que chama de um começo ingênuo, porém informativo, o modelo de default independente. A partir dele, mostra por que a independência elimina a cauda relevante da distribuição de perdas, como os modelos mixture e threshold recolocam um fator comum dentro da carteira, e por que a mesma estrutura reaparece, em versão regulatória, na fórmula da abordagem baseada em classificações internas (IRB).

O modelo mais ingênuo que se pode defender

Suponha uma carteira com I tomadores distintos. Para cada tomador i, conhecemos três quantidades: a exposição em caso de default, denotada ci (em inglês exposure-at-default, EAD), a probabilidade de default no horizonte de análise, pi, e a perda dado default, γi. Um indicador 𝟙Di assume valor 1 se o tomador entra em default entre t e T, e 0 caso contrário. A perda total da carteira no horizonte T se escreve então como uma soma simples sobre os tomadores.

Essa expressão é o ponto de partida de qualquer modelo de risco de crédito de carteira. O que a diferencia entre modelos distintos é como os 𝟙Di se comportam conjuntamente. A escolha mais simples, e também a mais questionável, é assumir que cada indicador é uma realização Bernoulli com probabilidade pi e que todos são mutuamente independentes. É o chamado independent-default model, e Bolder (2022, p. 54) o apresenta justamente por sua clareza pedagógica.

Se as PDs forem iguais e os ciγi forem homogêneos, o número de defaults segue uma distribuição binomial com parâmetros (I, p). Para I grande e p pequeno, a aproximação de Poisson com intensidade λ = Ip é útil para cálculo de caudas. O modelo é elegante, tratável, e pode até ser resolvido analiticamente. Também é fatalmente errado, por uma razão que se revela num experimento numérico simples.

O paradoxo da diversificação

Considere uma carteira com I = 100 tomadores, todos com PD = 1%, exposição unitária e LGD de 40%. A perda esperada é E[L] = I · p · γ = 0,40 em unidades de exposição. Sob independência, um milhão de simulações produz desvio-padrão de 0,40, VaR a 99% de 1,60, VaR a 99,9% de 2,00 e expected shortfall (ES) a 99% de 1,69. Nenhuma perda das 106 simuladas ultrapassou 9 defaults simultâneos. Agora aumentamos I para 10 mil. A perda esperada cresce para 40, mas o VaR 99% normalizado pela média, VaR/E[L], cai de 3,98 (com I = 100) para 1,24 (com I = 10 mil). No limite I → ∞, a lei dos grandes números garante que L/I converge quase certamente para E[L]/I; em termos relativos, o capital econômico acima da perda esperada tende a desaparecer.

Nessa toada, basta tornar a carteira grande o suficiente e o risco de crédito desaparece por diversificação, embora essa conclusão venha da hipótese de independência, não de uma propriedade econômica robusta. Ao tratar cada default como independente dos demais, o modelo elimina por construção o risco sistêmico. O ciclo econômico, choques setoriais e contágio entre tomadores fazem com que defaults se aglomerem nos mesmos trimestres, especialmente em recessões. Frey e McNeil (2003) mostram que correlações de ativos modestas, entre 10% e 20%, podem multiplicar o VaR a 99,9% por fatores de cinco a vinte vezes.

A segunda consequência é mais sutil e igualmente incômoda. Sob independência, a perda agregada concentra-se em torno da média com caudas que decaem exponencialmente. Crises reais exibem caudas muito mais pesadas, em que vários tomadores grandes falham no mesmo período. Qualquer medida de capital baseada em quantis extremos (VaR a 99,97%, por exemplo) subestima sistematicamente a verdadeira exigência de capital quando calibrada sobre o modelo independente.

Bolder (2018, cap. 2) e Bluhm, Overbeck e Wagner (2010, cap. 1) observam que, apesar disso, o modelo tem um papel útil como challenger. Ele pode funcionar como um segundo número, calculado em paralelo ao modelo de produção, cuja função é sinalizar erros grosseiros de implementação. Por ser trivial de implementar e auditar, serve de âncora de sanidade, embora não possa descrever o mundo que o modelo principal tenta capturar.

Duas escolas de modelagem para introduzir risco sistêmico

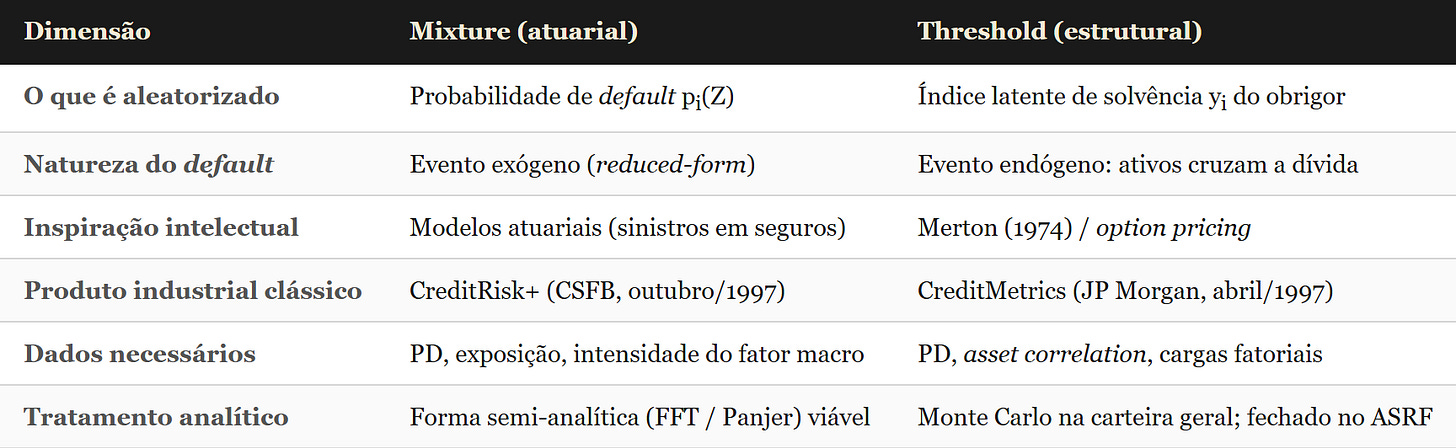

Se a independência é a raiz do problema, a saída precisa introduzir alguma forma de dependência entre os defaults. A literatura do setor convergiu em duas estratégias, cada uma associada a um modelo dominante e a uma tradição intelectual distinta. McNeil, Frey e Embrechts (2015, cap. 11) organizam a taxonomia da maneira que se tornou canônica: mixture models de um lado, threshold models do outro.

Na estratégia mixture, a probabilidade de default de cada tomador deixa de ser um parâmetro fixo e passa a ser uma função de uma variável aleatória comum Z, interpretável como estado da economia. Em cada simulação, sorteia-se um valor de Z, que reescreve as probabilidades pi(Z) de todos os tomadores. Dado Z, os defaults voltam a ser independentes entre si (propriedade de conditional independence), mas a aleatoriedade de Z introduz correlação entre os eventos. O exemplo canônico é o modelo gamma-Poisson do CreditRisk+, que decompõe a probabilidade randomizada em uma parte idiossincrática e uma parte sistêmica:

Os coeficientes ωi0 e ωi1 somam 1 e controlam o peso relativo de cada componente (CREDIT SUISSE FINANCIAL PRODUCTS, 1997; WILDE, 2010). Essa abordagem é chamada de reduced-form ou atuarial porque trata o default como evento exógeno, sem especificar o mecanismo pelo qual ele ocorre. Para algumas escolhas do mixing (gamma, beta, logit-normal), a distribuição de perdas admite forma semi-analítica, dispensando Monte Carlo.

Na estratégia threshold, a inspiração é outra. Logo depois do paper de Black e Scholes (1973), Merton (1974) observou que o equity de uma firma pode ser visto como uma opção de compra sobre seus ativos, de modo que o default ocorre quando o valor dos ativos cai abaixo da dívida. Vasicek (2002) simplificou essa intuição contínua para um modelo de um período, no qual cada tomador carrega uma variável latente yi, interpretável como retorno normalizado dos ativos ou índice de capacidade de crédito. Um fator sistêmico Z e um choque idiossincrático εi, ambos normais padrão, compõem yi linearmente:

O default do tomador i ocorre quando yi cruza um limiar Ki. Como as variáveis são normais padrão, a calibração do limiar sai da relação E[𝟙yi≤Ki] = pi, que leva diretamente a Ki = Φ-1(pi). Essa construção tem a vantagem de ser endógena. Default é consequência de um mecanismo (ativos cruzarem dívida) e não apenas um evento atribuído de fora. CreditMetrics (GUPTON; FINGER; BHATIA, 1997) generaliza a lógica para múltiplos fatores e múltiplos estados de rating, usando cópula gaussiana e matriz de transição histórica para construir os limiares.

As duas tradições podem chegar a distribuições de perda parecidas, embora contem histórias diferentes sobre o que está acontecendo. Gordy (2000) mostra que existe um mapeamento formal entre elas sob certas condições. Para o leitor que precisa escolher, a diferença concreta está menos no comportamento estatístico e mais no tipo de dado disponível: mixture dispensa dados de balanço e lida bem com tomadores sem ações negociadas, enquanto threshold se beneficia de informação sobre ativos e pode incorporar migração de rating de forma natural. A abordagem IRB regulatória segue a lógica threshold de um fator, e é por esse caminho que seguimos aqui.

A mecânica do threshold de um fator

Construir o índice yi exige uma escolha difícil: quanto da sorte do tomador é dele, e quanto é da economia. No caso de um único fator, a resposta aparece em uma decomposição simples:

O choque Z é comum a todos os tomadores; εi é específico do tomador i. O parâmetro αi controla o peso sistêmico: αi = 0 reduz o modelo ao caso independente; αi = 1 elimina a parcela idiossincrática. A raiz quadrada garante que ΔXi continue com variância unitária, de modo que o limiar de default permanece calibrado por Φ-1(pi).

Bolder (2022) escreve a versão mais geral dessa ideia partindo de uma equação diferencial estocástica para o índice de capacidade de crédito, discretizando o tempo e acomodando múltiplos fatores sistêmicos. O índice incremental entre t e t+1 fica:

O vetor Bi tem dimensão J e carrega as cargas normalizadas do tomador i nos J fatores sistêmicos; Δz é o vetor de choques sistêmicos correlacionados, de dimensão J; Δwi é o choque idiossincrático, normal padrão e independente tanto entre tomadores quanto do vetor Δz. A normalização BiΩBiT = 1 preserva a mesma lógica do caso de um fator: ΔXi ∼ 𝒩(0,1), e o limiar continua sendo Φ-1(pi).

No caso de um único fator sistêmico, a correlação de ativos entre dois tomadores n e m fica:

A fórmula IRB de Basileia II se apoia nesse mesmo núcleo de fator único assintótico (Asymptotic Single Risk Factor, ASRF), como mostram Gordy (2003) e o Comitê de Basileia (BCBS, 2005). A Resolução BCB 303/2023 não cita Vasicek nominalmente, mas adota a mesma forma funcional da abordagem IRB. O fator K (exigência de capital por unidade de exposição) é calculado com N, N-1, PD, LGD e um fator de correlação R aplicado ao quantil 99,9% do fator sistêmico. No modelo de um fator, esse R ocupa o mesmo papel de αi², isto é, a correlação de ativos regulatória. No regime brasileiro, R depende da categoria de exposição e, em vários casos, também da PD. Para atacado, por exemplo, a curva-base se move entre 0,12 e 0,24. Para exposições residenciais de varejo, R é 0,15. Para crédito rotativo de varejo qualificado, R é 0,04. Nesse caso, a decomposição em parte sistêmica e idiossincrática vira objeto regulatório calibrável.

Como αi entra ao quadrado na correlação, αi = 0,30 corresponde a uma correlação de ativos de 0,09. Esse valor fica ligeiramente abaixo da curva-base de atacado da fórmula IRB brasileira, mas permanece na mesma ordem de grandeza dos parâmetros regulatórios usuais. É esse o valor usado nos resultados numéricos a seguir, como benchmark didático, não como calibração regulatória.

Implementação em Julia

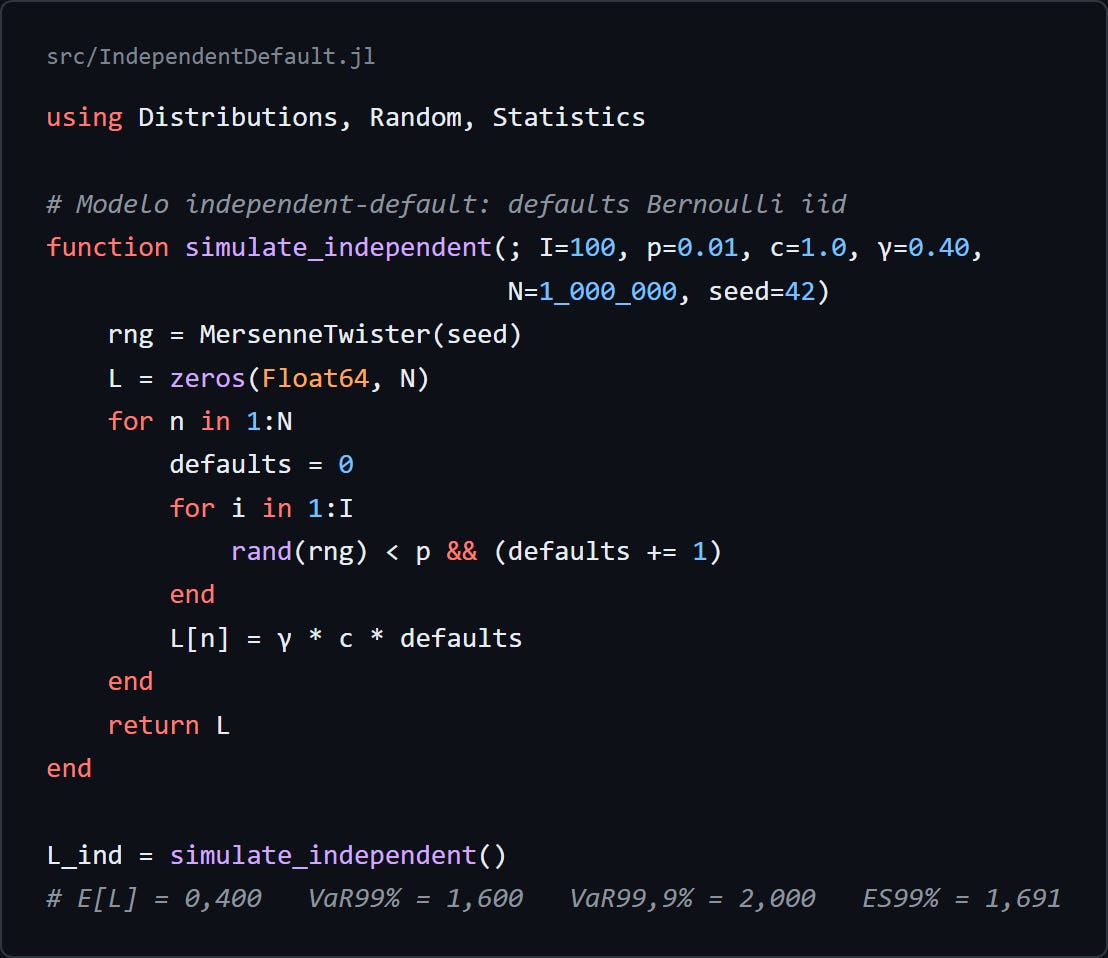

A estrutura acima se traduz em Julia de forma quase literal. O modelo independente se resume a sortear I Bernoullis iid por simulação e somar as perdas. Usamos Distributions.jl para as distribuições e Random para reprodutibilidade.

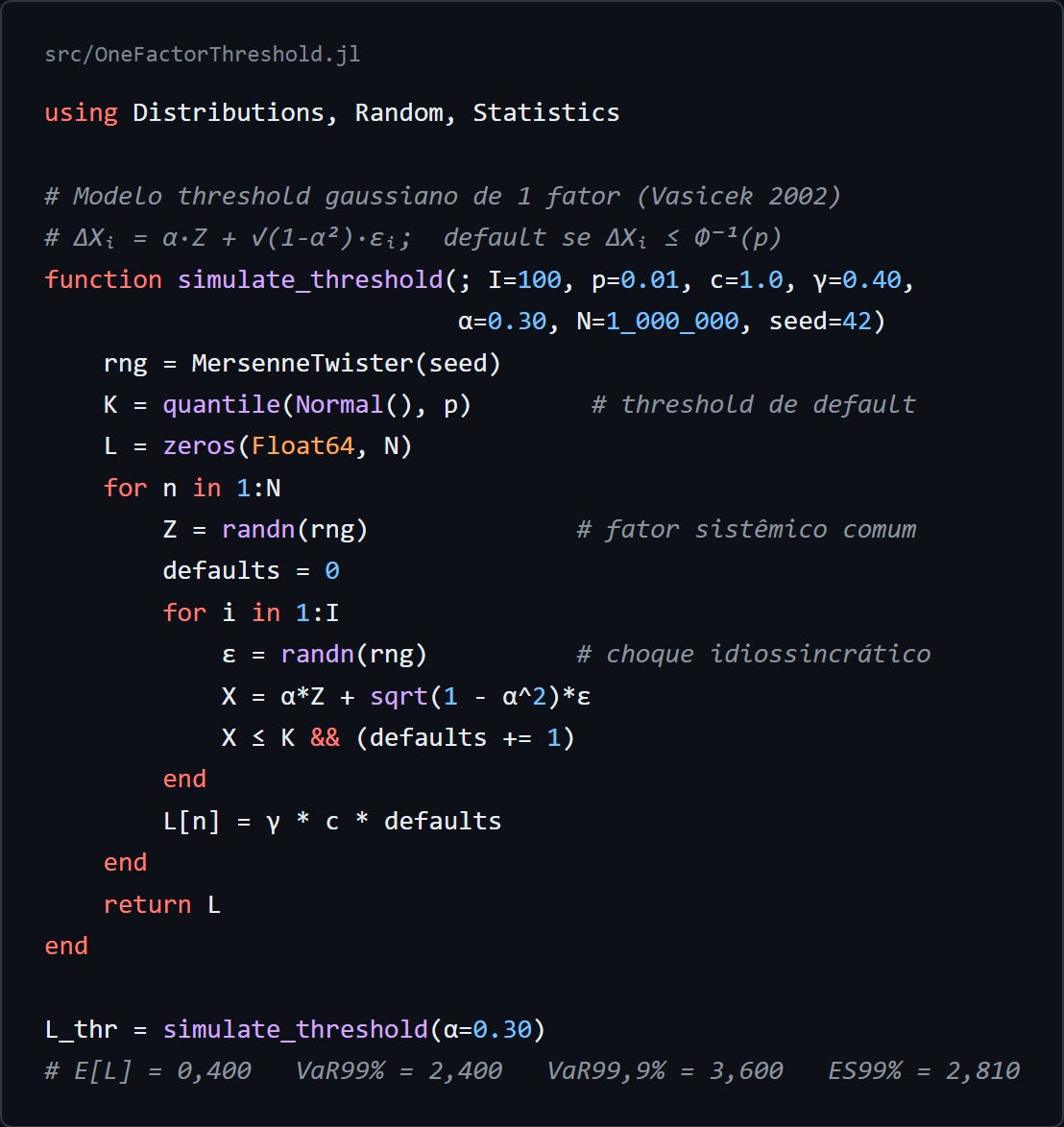

O modelo threshold de um fator exige um passo adicional. Em cada simulação, sorteamos um valor de Z, construímos os ΔXi como combinação linear ponderada, e comparamos com o limiar Ki = Φ-1(pi) para definir se o tomador quebrou. Como Ki depende apenas de pi, ele é pré-calculado. O parâmetro α controla a intensidade do acoplamento sistêmico.

Os dois códigos diferem apenas na forma como o vetor de defaults é gerado em cada iteração. A função simulate_threshold precisa sortear o choque sistêmico Z antes de compor os ΔXi, e é essa dependência comum que transforma o comportamento da cauda. Para o leitor interessado na implementação completa, com acesso ao gerador usado nos gráficos abaixo e às rotinas de agregação, há um repositório com os dois modelos e as rotinas de visualização: pq_bolder_cap2 (procurar em parte1).

O que a cauda mostra

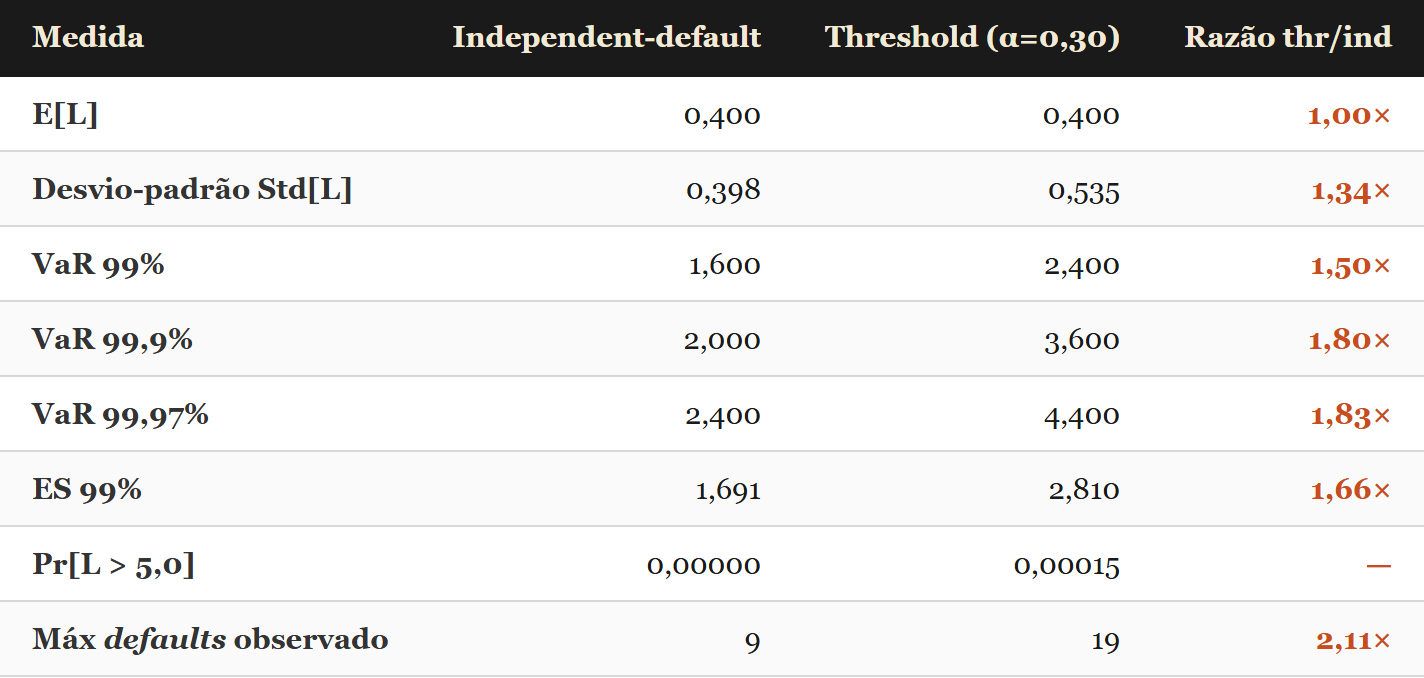

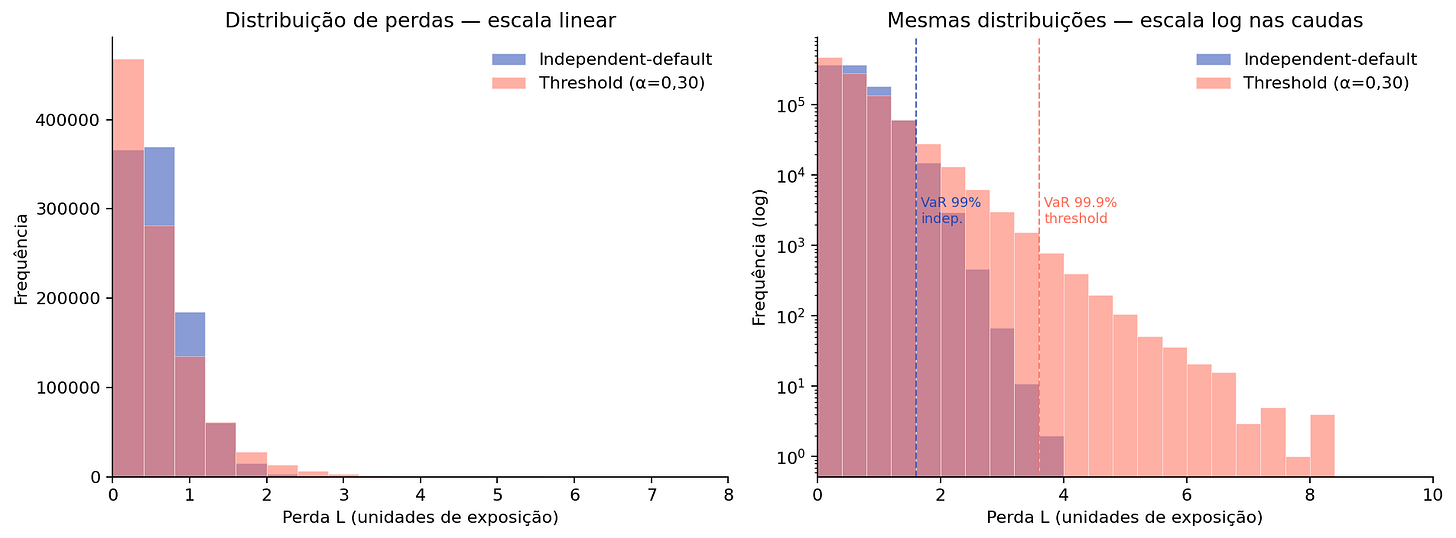

Rodando ambos os modelos com I = 100 tomadores, PD = 1%, LGD = 40%, exposição unitária e 106 simulações, obtemos as distribuições de perda esperadas. A perda média é 0,40 nos dois modelos, porque só depende de PD, LGD e exposição, mas o resto da distribuição diverge. A Tabela 2 resume as métricas de cauda para α = 0,30.

A média é a mesma por construção, o que era esperado, porque ambos os modelos respeitam pi como PD marginal. O desvio-padrão já cresce 34% no modelo threshold, porque agora existe uma fonte adicional de variabilidade (o fator sistêmico Z). Onde a diferença fica economicamente relevante é nos quantis extremos. O VaR a 99% sobe 50%, VaR a 99,9% sobe 80%, VaR a 99,97% (quantil usado como referência por Bolder para stress severo) sobe 83%. O ES a 99%, medida de perda média condicional além do VaR, sobe de 1,69 para 2,81. Nenhuma dessas diferenças vem da calibração de PD ou LGD. Vêm exclusivamente de assumir ou não que os defaults compartilham um estado da economia comum.

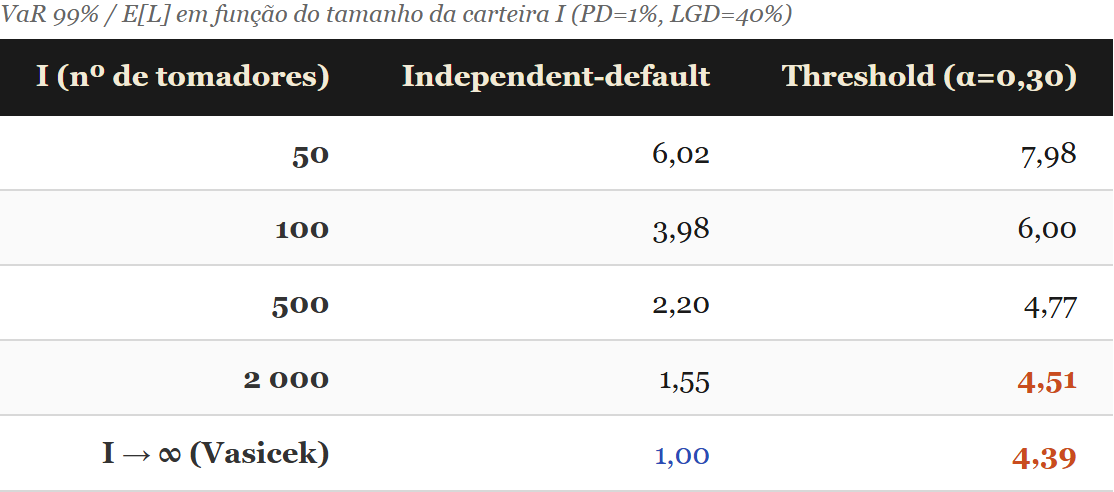

O experimento da diversificação, que no modelo independente faz o VaR convergir para a média, tem desfecho oposto no threshold. Fixando α = 0,30 e variando o tamanho da carteira, observa-se que a razão VaR 99% / E[L] permanece em torno de 4,5 mesmo com I = 2 mil tomadores, enquanto no modelo independente essa razão cai abaixo de 1,6 já em I = 2 mil e tende a 1 com I ainda maior.

Esses números separam dois tipos de risco que o modelo independente misturava mal. O risco de crédito idiossincrático pode ser diluído aumentando o número de tomadores, enquanto o risco sistêmico, por atingir toda a carteira simultaneamente, não se reduz por esse caminho. No limite de carteira infinita e um único fator, a perda condicional E[L|Z] tem forma fechada (VASICEK, 2002) e compõe o bloco central da fórmula IRB. O cálculo regulatório avalia a perda condicional em um cenário sistêmico adverso, subtrai a perda esperada e incorpora ajustes adicionais, como maturidade. Gordy (2003) formaliza esse resultado por meio da portfolio invariance. Sob hipóteses restritivas, um modelo ASRF permite uma regra de capital aditiva para carteiras grandes e granulares, ao passo que extensões como mais fatores, não gaussianidade e concentração ficam fora dessa simplificação de Pilar 1 e precisam ser tratadas no Pilar 2/ICAAP.

Encerramento

Entre o modelo binomial dos anos 80 e a forma final do Vasicek, a mudança conceitual passa por reconhecer que defaults dependem de um estado da economia comum, escolher entre randomizar a probabilidade (mixture) ou randomizar o estado do tomador (threshold), e aceitar a suposição gaussiana como forma conveniente de implementar o acoplamento. Daí surge um modelo pequeno o bastante para caber em cem linhas de Julia, mas capaz de produzir distribuições de perda com caudas plausíveis e de dialogar diretamente com a regra de capital que aparece na supervisão bancária.

A hipótese de independência era o primeiro problema, e o modelo de um fator responde a ela ao colocar todos os tomadores sob o mesmo estado da economia. Essa solução, no entanto, depende de outra escolha forte, pois a normalidade conjunta é o que permite transformar uma correlação de ativos em distribuição de perdas de forma tão direta.

A normalidade conjunta torna o modelo tratável porque conecta PD, limiar de default e correlação de ativos em uma única construção probabilística, mas também impõe uma restrição importante sobre os extremos. Para correlação menor que 1, a cópula gaussiana tem dependência de cauda nula, de modo que, condicionada a um tomador estar em um quantil cada vez mais extremo, a probabilidade de outro tomador acompanhar esse mesmo evento extremo tende a zero. Isso não significa que a probabilidade conjunta seja igual ao produto das PDs em níveis finitos, e sim que a cópula não preserva co-movimento extremo no limite.

MacKenzie e Spears (2014) documentaram como essa propriedade silenciosa contribuiu para a subprecificação do risco de tranches sêniores de CDOs nos anos que antecederam 2008. A literatura respondeu migrando para cópulas com dependência de cauda não-nula, sendo a cópula t a escolha mais comum em produção. Depois de abandonar a independência, a pergunta natural deixa de ser se os tomadores dependem de um fator comum e passa a ser se a dependência gaussiana continua adequada justamente na região em que o capital econômico é definido, a cauda da distribuição de perdas.

Referências

BASEL COMMITTEE ON BANKING SUPERVISION. An Explanatory Note on the Basel II IRB Risk Weight Functions. Basel: Bank for International Settlements, July 2005. Disponível em: https://www.bis.org/bcbs/irbriskweight.pdf.

BANCO CENTRAL DO BRASIL. Resolução BCB nº 303, de 16 de março de 2023: estabelece procedimentos para o cálculo da parcela dos ativos ponderados pelo risco (RWA) relativa ao cálculo do capital requerido para o risco de crédito mediante abordagem baseada em classificação interna (IRB). Brasília: BCB, 2023.

BLACK, F.; SCHOLES, M. The Pricing of Options and Corporate Liabilities. Journal of Political Economy, v. 81, n. 3, p. 637-654, 1973.

BLUHM, C.; OVERBECK, L.; WAGNER, C. Introduction to Credit Risk Modeling. 2. ed. Boca Raton: Chapman & Hall/CRC, 2010.

BOLDER, D. J. Credit-Risk Modelling: Theoretical Foundations, Diagnostic Tools, Practical Examples, and Numerical Recipes in Python. Cham: Springer, 2018.

BOLDER, D. J. Modelling Economic Capital: Practical Credit-Risk Methodologies, Applications, and Implementation Details. Cham: Springer, 2022. (Contributions to Finance and Accounting).

CREDIT SUISSE FINANCIAL PRODUCTS. CreditRisk+: A Credit Risk Management Framework. London: Credit Suisse Financial Products, 1997.

FREY, R.; McNEIL, A. J. Dependent Defaults in Models of Portfolio Credit Risk. Journal of Risk, v. 6, n. 1, p. 59-92, 2003.

GORDY, M. B. A Comparative Anatomy of Credit Risk Models. Journal of Banking & Finance, v. 24, n. 1-2, p. 119-149, 2000.

GORDY, M. B. A Risk-Factor Model Foundation for Ratings-Based Bank Capital Rules. Journal of Financial Intermediation, v. 12, n. 3, p. 199-232, 2003.

GUPTON, G. M.; FINGER, C. C.; BHATIA, M. CreditMetrics: Technical Document. New York: J.P. Morgan & Co. Incorporated, 1997.

MACKENZIE, D.; SPEARS, T. ‘The formula that killed Wall Street’: the Gaussian copula and modelling practices in investment banking. Social Studies of Science, v. 44, n. 3, p. 393-417, 2014.

McNEIL, A. J.; FREY, R.; EMBRECHTS, P. Quantitative Risk Management: Concepts, Techniques and Tools. Revised ed. Princeton: Princeton University Press, 2015.

MERTON, R. C. On the Pricing of Corporate Debt: The Risk Structure of Interest Rates. The Journal of Finance, v. 29, n. 2, p. 449-470, 1974.

VASICEK, O. A. Loan Portfolio Value. Risk, v. 15, n. 12, p. 160-162, 2002.

WILDE, T. CreditRisk+. In: CONT, R. (ed.). Encyclopedia of Quantitative Finance. Chichester: Wiley, 2010. DOI: 10.1002/9780470061602.eqf09009.