Além dos riscos (parte 3): teoria do caos em finanças

Entre atratores estranhos e o VIX: o que a teoria do caos ensina sobre mercados e incerteza.

A descoberta de Lorenz

Em 1961, no MIT, Edward N. Lorenz usava um computador Royal McBee LGP-30 para estudar convecção atmosférica com um modelo de doze equações diferenciais não lineares acopladas. Ao reexaminar uma sequência, decidiu economizar tempo reiniciando a simulação no meio e digitou o valor impresso em papel: 0,506. O computador, porém, trabalhava internamente com seis casas decimais; o estado real era 0,506127, mas a impressora registrava apenas três. A diferença de 0,000127, cerca de 0,025%, parecia irrelevante à luz dos padrões experimentais da época. Todo o restante do procedimento permaneceu igual.

De início, as trajetórias nova e original coincidiam. Depois de cerca de cinco dias de tempo simulado, surgiram pequenas diferenças; por volta de trinta dias, a discrepância já era grande; e em aproximadamente sessenta dias, as previsões eram incompatíveis. Lorenz revisou código, refez cálculos e variou pontos de partida. O padrão se repetiu: perturbações mínimas nas condições iniciais levavam, após dezenas de iterações, a evoluções qualitativamente distintas.

O resultado tinha alcance conceitual amplo. Desde Laplace, vigorava a ideia de que sistemas determinísticos seriam, em princípio, previsíveis se o estado inicial fosse conhecido com exatidão. A mecânica quântica relativizou isso em outra frente, mas muitos ainda supunham que variáveis ocultas poderiam restaurar o determinismo pleno. A contribuição de Lorenz mostrou algo diferente: mesmo sem aleatoriedade, a sensibilidade a condições iniciais impõe um limite prático à previsão. Incertezas inevitáveis de medição e de representação numérica são amplificadas exponencialmente, reduzindo o horizonte de confiança dos modelos.

Assim, o sistema permanece determinístico, um estado inicial perfeitamente conhecido determinaria o futuro, mas é imprevisível na prática em prazos mais longos. Essa constatação inaugurou o estudo do caos determinístico na meteorologia e em outras áreas e redefiniu expectativas sobre o que a modelagem numérica pode antecipar ao longo do tempo.

A matemática da coisa

Fascinado pela descoberta, Lorenz passou dois anos buscando uma formulação mínima que explicasse o fenômeno. Supôs que o comportamento caótico era típico de sistemas não lineares com realimentação, não algo peculiar ao seu modelo meteorológico. Em 1963, publicou Deterministic Nonperiodic Flow (LORENZ, 1963), apresentando um sistema de três equações diferenciais ordinárias que condensava a convecção térmica:

No esquema físico, x mede a intensidade da circulação convectiva, y a diferença de temperatura entre correntes ascendentes e descendentes e z o desvio do perfil térmico em relação ao gradiente linear. Os parâmetros foram escolhidos com base em quantidades relevantes: σ=10 (número de Prandtl, água), ρ=28 (acima do limiar crítico ≈24,74, onde surge o caos, mas ainda analisável) e β=8/3 (razão geométrica da célula convectiva).

Ao examinar as trajetórias no espaço (x,y,z), Lorenz verificou que não havia convergência a ponto fixo nem explosão; as órbitas permaneciam confinadas em uma estrutura com dois lóbulos, alternando entre eles conforme a dinâmica evoluía. O sistema é totalmente determinístico, mas exibe sensibilidade a condições iniciais: trajetórias que partem muito próximas divergem a uma taxa exponencial.

Essa região invariante, o atrator estranho de Lorenz, tem dimensão de Hausdorff ≈ 2,06, o que significa que ele é mais complexo que uma superfície (dimensão 2), mas não chega a preencher um volume (dimensão 3). Se esse número estivesse mais perto de 2, a dinâmica seria “mais fina” e regular; se estivesse mais perto de 3, seria mais “cheia” e turbulenta. Já o maior expoente de Lyapunov λ₁ ≈ 0,9056 é positivo, sinal claro de caos: duas trajetórias quase idênticas se afastam rapidamente. Quanto maior o λ₁, mais rápido cresce esse afastamento e menor é o horizonte útil de previsão; se λ₁ fosse zero ou negativo, não haveria essa sensibilidade (seria previsível ou estável). Décadas depois, em 1999, Warwick Tucker mostrou de forma rigorosa que esse atrator realmente existe para os parâmetros clássicos do modelo.

A expressão efeito borboleta se popularizou mais tarde, em 1972, quando Lorenz proferiu uma palestra na reunião da American Association for the Advancement of Science. Sem ter enviado um título, viu o organizador Philip Merilees propor a pergunta “Predictability: Does the Flap of a Butterfly’s Wings in Brazil Set Off a Tornado in Texas?”. A formulação sintetizava a ideia central: pequenas variações iniciais podem levar a grandes diferenças posteriores. Dessa forma, ajudou a difundir o conceito para além da meteorologia. Desde então, o modelo de 1963 tornou-se referência para estudar caos determinístico em sistemas físicos simples, clarificando por que previsões de longo prazo podem ser intrinsecamente limitadas mesmo na ausência de ruído aleatório.

Abaixo, o exemplo do fenômeno. A bola amarela e a bola vermelha são lançadas por uma pequena diferença de condição inicial. Durante uma parte da simulação elas seguem juntas, mas a partir de um determinado momento elas se “separam”, indo de um atrator para outro em momentos imprevisíveis. Observe que não há qualquer componente aleatório ou perturbação no sistema, é tudo determinístico. O código que gerou a animação está disponível em pq_lorenz.

O caos e a incerteza knightiana

A imprevisibilidade do caos pode ser enquadrada como uma forma de incerteza knightiana em seus efeitos práticos, ainda que suas origens teóricas sejam distintas. A conexão entre os dois conceitos revela os limites do nosso conhecimento diante de sistemas complexos.

A incerteza knightiana, que foi abordada no artigo Além dos riscos (parte 1): incerteza knightiana e paradoxo de Ellsberg, descreve um futuro onde não apenas desconhecemos a probabilidade dos eventos, mas também a própria estrutura do modelo que os gera. É a incerteza radical do desconhecido, como o impacto de uma nova invenção ou uma crise geopolítica sem precedentes. É um problema de ignorância sobre as regras do jogo.

O caos determinístico, por outro lado, parte de um pressuposto oposto: as regras do jogo são perfeitamente conhecidas. O sistema é governado por equações fixas, sem nenhum elemento de acaso. Como é impossível medir o estado inicial de um sistema complexo com precisão infinita, qualquer minúscula margem de erro é amplificada exponencialmente, tornando as previsões de longo prazo impossíveis.

É exatamente nessa impossibilidade prática que os dois conceitos se encontram. Para um observador no mundo real, como um analista de mercado, a incapacidade de medir com perfeição as condições iniciais de um sistema caótico produz o mesmo resultado que a ignorância sobre o modelo do sistema. Em ambos os casos, o futuro se torna opaco e não quantificável. A impossibilidade de prever a trajetória de um sistema, mesmo conhecendo suas regras, gera uma incerteza que, na prática, é indistinguível da incerteza knightiana.

Dessa forma, a teoria do caos nos mostra que um universo perfeitamente determinístico pode, para todos os efeitos práticos, se manifestar como um ambiente de incerteza radical, forçando-nos a aceitar os limites fundamentais da previsibilidade.

Uso limitado em finanças

Nas décadas de 1970–80, a teoria do caos se consolidou e, com a difusão de Black-Scholes (1973) e de computação mais acessível, físicos e matemáticos migraram para Wall Street. Surgiu a hipótese: se preços exibissem caos determinístico à la Lorenz, haveria estrutura explorável sob a aparente aleatoriedade.

Os primeiros testes foram cautelosos. Scheinkman e LeBaron (1989) aplicaram correlação integral a retornos semanais e encontraram não linearidades, mas sem prova conclusiva de atratores de baixa dimensão (SCHEINKMAN e LEBARON, 1989).

Hsieh (1991), em câmbio diário e usando dimensão de correlação, expoentes de Lyapunov, BDS e dados substitutos, rejeitou i.i.d., porém concluiu que a evidência de caos de baixa dimensão era fraca (HSIEH, 1991).

A síntese de Brock, Hsieh e LeBaron reforçou: dependências não lineares são comuns, mas distinguir caos determinístico de processos estocásticos não lineares é problemático, mesmo no melhor caso (BROCK et al., 1991).

Foi observado que as dificuldades são estruturais. Em termos de tamanho amostral, Ruelle estimou que para dimensionar um atrator com confiabilidade seriam necessárias cerca de 10 elevado a 2+0,4D observações (RUELLE, 1990); para D=3, mais de 31 mil pontos — algo que, mesmo com dados diários, exige séries de muitas décadas, enquanto regimes de mercado mudam em prazos bem menores.

Além disso, mercados são não estacionários: regras, tecnologia e microestrutura evoluem, tornando instável qualquer atrator fixo (PETERS, 1994). O ruído é onipresente: bid-ask bounce, erros de medição, ticks mínimos e notícias genuinamente aleatórias. Pequenas quantidades de perturbação externa já bastam para encobrir assinaturas de caos (DECHERT e GENÇAY, 1992).

Por fim, há a adaptação estratégica: padrões exploráveis tendem a desaparecer quando identificados em sistemas com muitos agentes aprendendo e reagindo, o que torna pouco plausível um atrator de baixa dimensão estável (LEBARON, 1994).

Em suma, a literatura detecta ampla não linearidade e dependências complexas, mas a hipótese de caos determinístico de baixa dimensão em preços de ativos permanece sem confirmação robusta. Mesmo que existisse localmente e por janelas curtas, o conjunto de limitações que envolve amostras finitas, não estacionaridade, ruído e adaptação, reduz a chance de extraí-lo de forma confiável e replicável (SCHEINKMAN e LEBARON, 1989; HSIEH, 1991; BROCK et al., 1991; RUELLE, 1990; PETERS, 1994; DECHERT e GENÇAY, 1992; LEBARON, 1994).

O VIX como laboratório de complexidade

Características do VIX

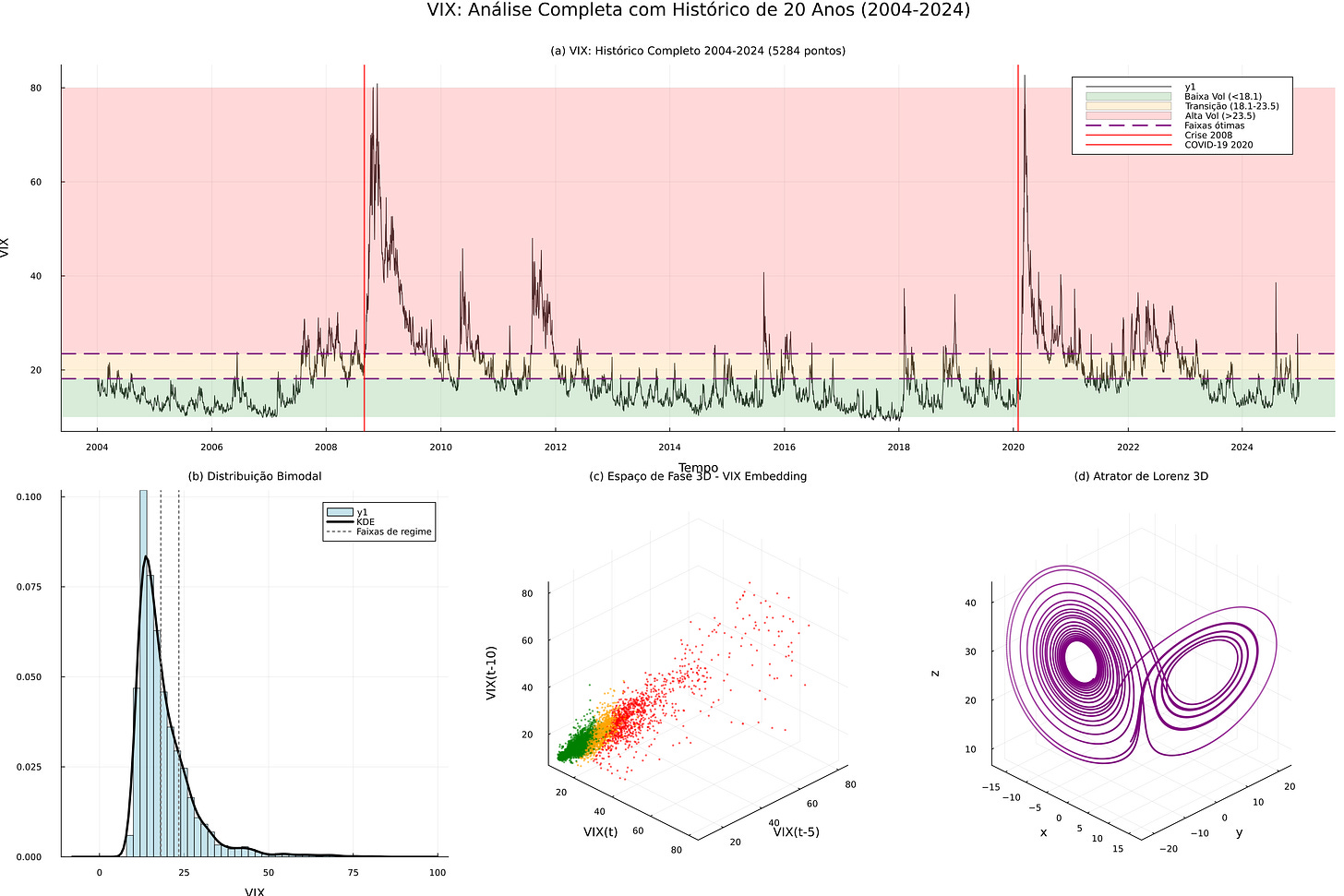

Se há um instrumento que convida comparações com sistemas caóticos, é o VIX — o Volatility Index do CBOE. Conhecido como índice do medo, mede a volatilidade implícita das opções do S&P 500 para os próximos 30 dias. Em essência: maior demanda por proteção (principalmente puts) encarece opções e eleva o VIX. Criado em 1993 por Robert Whaley e reformulado em 2003, o VIX agrega preços de várias opções de diferentes strikes. O resultado é a volatilidade anualizada esperada em 30 dias. Ex.: VIX=20 ≈ 20% ao ano (~5,8% no mês, pois √12 ≈ 3,46). Quanto mais caras as opções, sobretudo as puts out-of-the-money em pânico, maior o índice.

O VIX desafia modelos convencionais. Em dados diários (1990–2024), a distribuição é fortemente não-normal, com assimetria positiva (γ₁ ≈ 2,41) e caudas pesadas (γ₂ ≈ 11,87). Já o teste de Jarque-Bera rejeita normalidade (p≈0). Temporalmente, há alta persistência: ρ(1) ≈ 0,94 e decaimento lento, indicando memória longa e blocos de calmaria e de turbulência (volatility clustering).

O histograma dos valores do VIX é bimodal: um modo em ~13–15 e outro em ~25–30, com vale em ~18–22. Isso sugere dois regimes: complacência (baixa/moderada) e ansiedade (alta). Um modelo de Markov switching à la Hamilton (HAMILTON, 1989) quantifica que em baixa volatilidade possui média ≈ 13,82 e desvio padrão ≈ 2,14, com uma permanência diária de ≈ 97,9%, que corresponde a uma duração média ~47 dias. Já no cluster de alta volatilidade obtém-se média ≈ 28,91 e desvio padrão ≈ 7,83, com permanência ≈ 92,1%, correspondente a duração de ~13 dias. Já a faixa ~18–22 funciona como zona de transição rápida. A elevada persistência intra-regime e a raridade de estados intermediários apontam para heterogeneidade estrutural no processo do VIX.

A divisão em dois regimes lembra os lóbulos do atrator de Lorenz e pode sugerir um sistema caótico de baixa dimensão. Mas sem testes formais de caos, isso é apenas analogia. Transições abruptas podem surgir de choques de notícias, feedbacks de mercado (vendas forçadas) ou processos estocásticos não lineares, como GARCH com quebras de regime. É preciso de evidência empírica para distinguir caos determinístico de alternativas estocásticas.

Avaliação para verificar se o VIX é caótico

Reconstrução de Takens

Para investigar sinais mais diretos de caos determinístico, recorremos à reconstrução de espaço de fase de Takens. O teorema de Takens (TAKENS, 1981) nos diz que, se um sistema é verdadeiramente dinâmico determinístico de dimensão baixa, podemos reconstruir a dinâmica completa a partir de observações de uma única variável, usando cópias defasadas no tempo dessa variável como coordenadas. Ou seja, podemos construir vetores do tipo estado = [VIX(t), VIX(t–τ), VIX(t–2τ), ...] e, para τ (atraso) e dimensão adequados, esses pontos devem delinear o formato do possível atrator do sistema original em um espaço m-dimensional. As análises realizadas neste artigo estão disponíveis em PQ VIX.

Escolhemos um atraso τ=5 para o VIX usando os estudos de (FRASER e SWINNEY, 1986) e utilizamos m=3 dimensões (KENNEL et al., 1992) para representação. Com esses valores, a reconstrução revela duas regiões densas (regimes de baixa e alta volatilidade). O máximo que se observa é persistência e clusters de volatilidade, mas não uma órbita estável em um espaço de fases como o Lorenz 3D.

Dimensão de correlação

Analisamos a dimensão de correlação (D₂) do VIX em comparação com Lorenz. Este é um método (Grassberger & Procaccia, 1983) que estima a dimensão fractal do conjunto formado pelas trajetórias no espaço de fase. Essencialmente, verifica como o número de pares de pontos dentro de uma certa distância escala com essa distância, em escala log-log. Para o atrator de Lorenz, como mencionado, a dimensão de correlação conhecida é D₂ ≈ 2,06 – um número fractal um pouco acima de 2, indicando a geometria do atrator estranho (mais complexo que uma superfície lisa de dimensão 2, mas muito longe de preencher o volume 3D inteiro.

Quando aplicamos o mesmo cálculo aos dados do VIX, obtivemos um D₂ empiricamente em torno de 3,9. Esse valor deve ser tomado com ressalvas, pois amostras finitas e ruído tendem a fazer a dimensão estimada crescer e dificilmente saturar. No entanto, o fato de estimarmos algo perto de 4 sugere que se existe um atrator por trás do VIX, ele estaria em dimensão significativamente mais alta do que os 2–3 típicos de sistemas caóticos simples.

Na verdade, processos estocásticos com ruído efetivamente têm dimensão infinita, mas métodos de estimação podem acusar dimensões moderadas devido a estruturas temporárias ou limites de resolução. De todo modo, a comparação reforça: Lorenz tem um atrator de baixa dimensão, enquanto o VIX comporta-se como tendo dinâmica em dimensão bem mais elevada (no mínimo perto de 4, senão muito maior), o que é consistente com a ideia de que múltiplos fatores aleatórios influenciam o índice.

Expoente de Lyapunov

Para aprofundar, calculamos então um indicador chave de caos: o expoente de Lyapunov máximo. Este expoente (λ₁) mede a sensibilidade a condições iniciais: se dois estados do sistema começam infinitesimalmente próximos, λ₁ > 0 indicaria que a distância entre eles cresce exponencialmente no tempo (caos), ao passo que λ₁ = 0 sugere crescimento linear (dinâmica neutra) e λ₁ < 0 indica convergência (atração estável, sem caos).

Usamos o algoritmo prático de Rosenstein et al. (1993) para estimar λ₁ a partir da série temporal, porém nesse no espaço de fase com m=5, uma vez que é uma boa prática adotar m maior ou igual do que a dimensão de correlação mais um. Esse método considera pares de pontos inicialmente próximos no espaço reconstruído e acompanha a separação deles ao longo de k passos futuros. Aplicando ao VIX, encontramos valores marginalmente positivos, na faixa de λ ≈ 0,03 (em unidades de “1/dia”), a depender do período analisado. Isso significa que há uma leve divergência exponencial aparente. Contudo, esse valor é muito próximo de zero, e dentro da margem de erro e variância da estimativa – ou seja, não podemos afirmar que seja significativamente diferente de zero.

Em contraste, para o sistema de Lorenz (com parâmetros clássicos), obtemos λ₁ ≈ 0,9 por unidade de tempo, um valor claramente positivo e robusto.

Portanto, no VIX não detectamos um expoente de Lyapunov claramente positivo e distinto de zero, o que seria a assinatura inequívoca de caos determinístico de baixa dimensão, enquanto no sistema de Lorenz essa assinatura salta aos olhos.

Expoente de Hurst

Outro indicador que avaliamos foi o expoente de Hurst H, que mede a persistência de longo prazo de uma série. Em processos aleatórios, H = 0,5; se H > 0,5, há dependência de longo alcance (persistência), e se H < 0,5, há reversão (antipersistência). Calculamos H para o VIX e obtivemos cerca de 0,30, indicando uma forte antipersistência: basicamente, depois de grandes movimentos para cima, tendem a vir movimentos para baixo (o que condiz com a natureza de “spikes” de medo seguidos de calma). Já para o sistema de Lorenz (analisando, por exemplo, a série da coordenada x), encontramos H próximo de 1,0 – o que faz sentido, pois um sistema determinístico suave não tem reversões estatísticas aleatórias; ele segue um caminho que, do ponto de vista de um observador parcial, pode parecer altamente persistente.

Em termos práticos, o VIX mostra características de um processo de reversão à média, enquanto o Lorenz, não tendo ruído, não reverte no mesmo sentido estatístico – seu comportamento é dominado pela dinâmica determinista interna, não por choques aleatórios que o levem de volta a uma média.

Então entender sobre caos é inútil para finanças?

Não é bem assim, técnicas relacionadas podem ajudar em alguma coisa. Embora falte evidência convincente de um atrator de baixa dimensão nos preços, a teoria do caos tem utilidade prática como ferramenta de diagnóstico e controle.

A primeira aplicação é medir previsibilidade local: quando a taxa de crescimento do erro fora da amostra (ou um expoente de Lyapunov efetivo) aumenta, o horizonte de previsão deve encurtar e a alavancagem diminuir; quando a divergência é baixa, há mais espaço para alongar janelas e assumir um pouco mais de risco. Essa leitura é dinâmica, ajustada continuamente, e evita confiar em um único modelo fixo em ambientes que mudam rápido.

A análise de recorrência, ainda não citada, ajuda a detectar mudanças de regime. Métricas como taxa de recorrência, determinismo e laminaridade indicam quão organizada está a dinâmica. Valores elevados sugerem fases mais estruturadas, em que modelos paramétricos e relações econômicas tendem a funcionar melhor; quedas nessas métricas apontam para fases mais erráticas, favorecendo métodos robustos, controle de volatilidade e proteções mais ativas. Vetores de atraso (construídos com defasagens adequadas) criam variáveis que capturam dependências não lineares úteis a árvores de decisão, métodos de reforço e redes neurais, sem exigir hipóteses fortes sobre a forma da relação.

Em suma, o caos serve menos para prever o que está distante e mais para modular modelo, horizonte e risco em tempo real. E, além disso, ajuda a entender que mesmo em ambientes com regras completamente conhecidas, a previsibilidade pode ser inviável e que nem tudo é culpa da aleatoriedade ou do desconhecimento sobre o modelo governante.

Referências

BARNETT, W. A.; GALLANT, A. R.; HINICH, M. J.; JUNGEILGES, J. A.; KAPLAN, D. T.; JENSEN, M. J. A single-blind controlled competition among tests for nonlinearity and chaos. Journal of Econometrics, v. 82, n. 1, p. 157-192, 1997.

BENETTIN, G.; GALGANI, L.; GIORGILLI, A.; STRELCYN, J. M. Lyapunov characteristic exponents for smooth dynamical systems and for Hamiltonian systems: A method for computing all of them. Meccanica, v. 15, n. 1, p. 9-20, 1980.

BROCK, W. A.; DECHERT, W. D.; SCHEINKMAN, J. A.; LEBARON, B. A test for independence based on the correlation dimension. Econometric Reviews, v. 15, n. 3, p. 197-235, 1996.

BROCK, W. A.; HSIEH, D. A.; LEBARON, B. Nonlinear dynamics, chaos, and instability: Statistical theory and economic evidence. Cambridge: MIT Press, 1991.

CBOE - CHICAGO BOARD OPTIONS EXCHANGE. VIX White Paper. Chicago: CBOE, 2019.

DECHERT, W. D.; GENÇAY, R. Lyapunov exponents as a nonparametric diagnostic for stability analysis. Journal of Applied Econometrics, v. 7, n. S1, p. S41-S60, 1992.

FRASER, A. M.; SWINNEY, H. L. Independent coordinates for strange attractors from mutual information. Physical Review A, v. 33, n. 2, p. 1134-1140, 1986.

GRANGER, C. W. J. Developments in the nonlinear analysis of economic series. The Scandinavian Journal of Economics, v. 93, n. 2, p. 263-276, 1991.

HAMILTON, J. D. A new approach to the economic analysis of nonstationary time series and the business cycle. Econometrica, v. 57, n. 2, p. 357-384, 1989.

HSIEH, D. A. Chaos and nonlinear dynamics: Application to financial markets. The Journal of Finance, v. 46, n. 5, p. 1839-1877, 1991.

INSTITUTIONAL INVESTOR. Ken Griffin on Citadel's trading strategies. Institutional Investor, 15 mar. 2022.

KENNEL, M. B.; BROWN, R.; ABARBANEL, H. D. Determining embedding dimension for phase-space reconstruction using a geometrical construction. Physical Review A, v. 45, n. 6, p. 3403-3411, 1992.

LEBARON, B. Chaos and nonlinear forecastability in economics and finance. Philosophical Transactions of the Royal Society A, v. 348, n. 1688, p. 397-404, 1994.

LORENZ, E. N. Deterministic nonperiodic flow. Journal of the Atmospheric Sciences, v. 20, n. 2, p. 130-141, 1963.

MEDALLION FUND LLC v. COMMISSIONER. Tax Court Memorandum. Washington: United States Tax Court, 2014.

PATTERSON, S. The quants: How a new breed of math whizzes conquered Wall Street and nearly destroyed it. New York: Crown Business, 2010.

PETERS, E. E. Fractal market analysis: Applying chaos theory to investment and economics. New York: John Wiley & Sons, 1994.

ROSENSTEIN, M. T.; COLLINS, J. J.; DE LUCA, C. J. A practical method for calculating largest Lyapunov exponents from small data sets. Physica D, v. 65, n. 1-2, p. 117-134, 1993.

RUELLE, D. Deterministic chaos: The science and the fiction. Proceedings of the Royal Society A, v. 427, n. 1873, p. 241-248, 1990.

SCHEINKMAN, J. A.; LEBARON, B. Nonlinear dynamics and stock returns. The Journal of Business, v. 62, n. 3, p. 311-337, 1989.

SILVERMAN, B. W. Using kernel density estimates to investigate multimodality. Journal of the Royal Statistical Society B, v. 43, n. 1, p. 97-99, 1981.

TAKENS, F. Detecting strange attractors in turbulence. In: RAND, D. A.; YOUNG, L. S. (Eds.). Dynamical systems and turbulence. Berlin: Springer, 1981. p. 366-381.

TUCKER, W. The Lorenz attractor exists. Comptes Rendus de l'Académie des Sciences, v. 328, n. 12, p. 1197-1202, 1999.

TULCHINSKY, I.; MADHAVAN, A.; MOHANTY, D.; CHEN, P. Finding alphas: A quantitative approach to building trading strategies. 2. ed. New York: Wiley, 2023.

WHALEY, R. E. Understanding the VIX. The Journal of Portfolio Management, v. 35, n. 3, p. 98-105, 2009.

ZUCKERMAN, G. The man who solved the market: How Jim Simons launched the quant revolution. New York: Portfolio, 2019.